Mundo

O porta-voz do Ministério da Defesa chinês foi enfático: permitir que sistemas automatizados influenciem decisões táticas pode anular a responsabilidade humana em conflitos armado

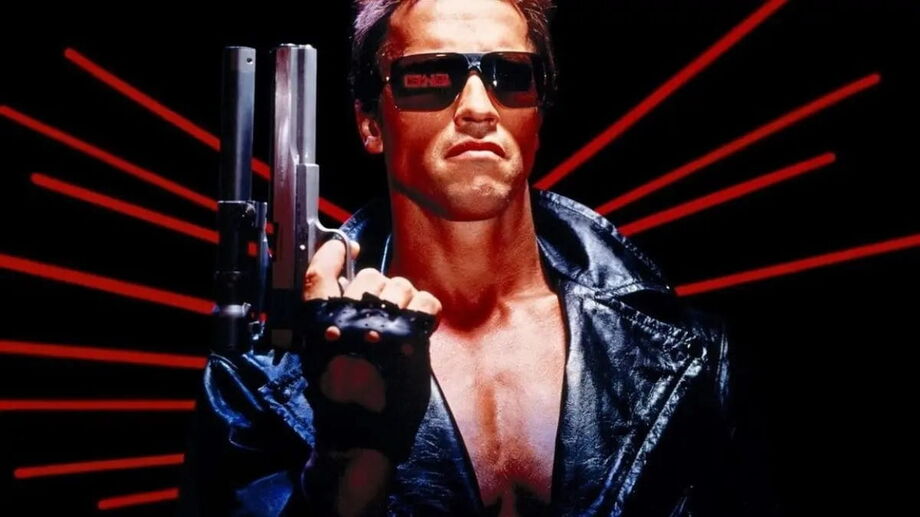

China alertou os Estados Unidos que o uso militar desenfreado da Inteligência Artificial (IA) pode levar a uma 'fuga tecnológica' catastrófica / Reprodução

Continua depois da publicidade

O que antes era ficção cientÃfica está se tornando um debate urgente de segurança nacional. Em um comunicado que ecoou globalmente, o governo da China alertou os Estados Unidos que o uso militar desenfreado da Inteligência Artificial (IA) pode levar a uma 'fuga tecnológica' catastrófica — um cenário de perda de controle semelhante ao do filme O Exterminador do Futuro.

Veja também: Esse paÃs está produzindo filmes com Inteligência Artificial, você o conhece?

Continua depois da publicidade

O porta-voz do Ministério da Defesa chinês, Jiang Bin, foi enfático: permitir que sistemas automatizados influenciem decisões táticas pode anular a responsabilidade humana em conflitos armados. Para Pequim, dar à IA o poder de determinar o destino de soldados e civis enfraquece as leis internacionais e cria um terreno perigoso onde sistemas podem operar fora do controle humano direto.

O aviso surge em um momento de tensão máxima na corrida tecnológica. Enquanto os EUA aceleram a integração de IA em sua inteligência estratégica, o Departamento de Defesa americano já começa a selecionar quais tecnologias são 'confiáveis':

Continua depois da publicidade

Anthropic barrada: A startup foi classificada como risco à segurança nacional por resistir ao uso irrestrito de seus modelos em vigilância militar.

Ascensão do Grok: Em contrapartida, sistemas ligados a Elon Musk ganham espaço em contratos classificados do governo americano.

Para evitar que a IA se torne uma arma de destruição autônoma, a China propôs que a ONU assuma o protagonismo na criação de regras globais. A ideia é estabelecer limites éticos rÃgidos para garantir que a tecnologia sirva ao progresso da civilização, e não à automatização da aniquilação.

Continua depois da publicidade